Od 0,11 megapiksela do asystentów sieci neuronowych: jak aparaty ewoluowały w smartfonach

Urządzenia / / January 06, 2021

Aparat w smartfonie stał się integralną częścią naszego życia: z jego pomocą zawsze możesz uchwycić ważny moment i podzielić się nim z innymi. Jednak aby to się urzeczywistniło, potrzeba było 20 lat postępu technicznego, redystrybucji rynku sprzętu fotograficznego i wielu innowacji. Postanowiliśmy przypomnieć sobie, jak fotografia mobilna wkroczyła w nasze codzienne życie i jakie firmy sprawiły, że było to proste i dostępne.

Pierwsze telefony z aparatem

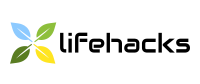

Po raz pierwszy aparat pojawił się w telefonie w 1999 roku: japońska firma Kyocera wypuściła model VP-210, który umożliwiał prowadzenie wideorozmów. Kamera znajdowała się z przodu i uchwyciła twarz właściciela z szybkością 2 klatek na sekundę. Mogła też robić selfie o rozdzielczości 0,11 megapiksela i przechowywać je w pamięci urządzenia w ilości do 20 sztuk.

W kolejnych latach kamery mobilne rozwijały się dynamicznie pod naporem konkurencji, a już w 2004 roku osiągnięto kamień milowy w postaci 1 miliona pikseli (1 megapiksel). A w 2005 roku rynek wstrząsnął dwoma modelami, które można nazwać pierwszymi aparatami telefonicznymi: Nokia N90 i Sony Ericsson k750i. Mieli 2-megapikselowe aparaty z autofokusem i robili ostre zdjęcia, a nie rozmyte abstrakcje. Wtedy to nastawienie użytkowników do fotografii mobilnej zaczęło się zmieniać: na Flickrze pojawiły się grupy tematyczne, ludzie zaczęli wymieniać się zdjęciami otrzymanymi na telefony i dyskutować o nich.

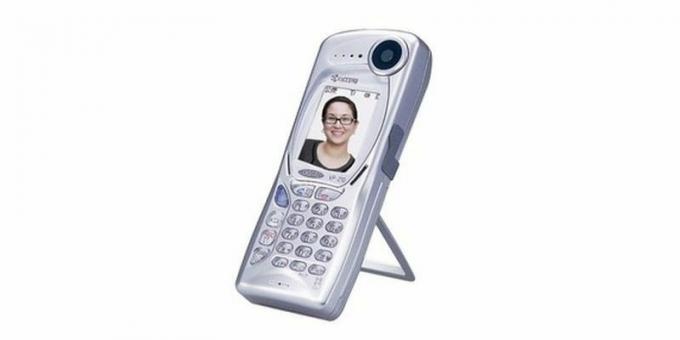

Z każdym kolejnym rokiem liczba osób robiących zdjęcia telefonem rośnie wykładniczo. Premiera iPhone'a w 2007 roku zmieniła podejście do urządzeń monofunkcyjnych: smartfony zaczęły zastępować odtwarzacze MP3, a następnie amatorskie aparaty fotograficzne i wideo.

Czytam teraz🔥

- 25 Zabawne wyszukiwanie w Google Jajka wielkanocne, o których możesz nie wiedzieć

Narodziny Instagrama

Załamanie rynku aparatów nastąpiło w 2010 roku wraz z uruchomieniem serwisu Instagram. Użytkownicy chcieli jak najłatwiej i jak najszybciej uzyskać atrakcyjne zdjęcie i zamieścić je w sieciach społecznościowych.

Jednocześnie poprawiła się jakość kamer mobilnych. Wprowadzony w 2011 roku iPhone 4s otrzymał 8-megapikselowy aparat i światłoczułą optykę z przysłoną f / 2.4. Takie cechy zaspokajały większość potrzeb: wciskasz przycisk, dostajesz jasną ramkę i ładujesz ją Instagram.

Z biegiem czasu przetwarzanie obrazów w smartfonach stało się bardziej agresywne: priorytetem jest kontrast, nasycenie i ostrość konturów, a naturalność obrazu wyblakła w tle. Ale były też próby wprowadzenia profesjonalnej technologii do aparatów mobilnych. Tak więc Nokia w 2012 roku wyprodukowała telefon z aparatem 808 PureView.

Model wyróżniał się cechami, które były jak na tamte czasy fenomenalne. Rozdzielczość aparatu wynosiła 41 Mp, a fizyczny rozmiar matrycy 1 / 1,2 ″. Został również wyposażony w mechaniczną migawkę, wbudowany filtr ND, obiektyw Carl Zeiss z przysłoną f / 2.4 oraz ksenonową lampę błyskową.

Niestety inni producenci nie spieszyli się z pójściem za przykładem Nokii, stawiając na filtry i inne dekoracje.

Więcej kamer, dobrych i innych

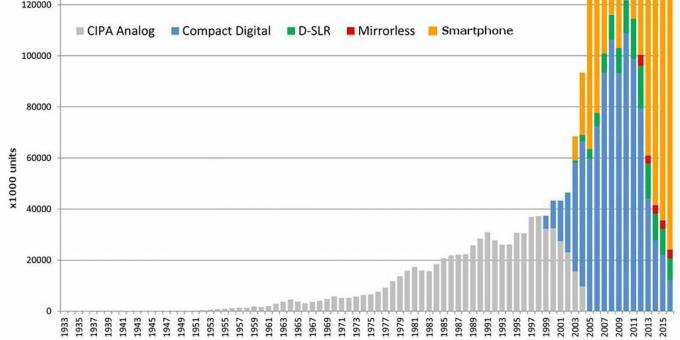

W pewnym momencie firmy zdecydowały się zwiększyć liczbę aparatów w smartfonach. W 2011 roku wypuszczono HTC Evo 3D i LG Optimus 3D, które wykorzystywały po dwa obiektywy do tworzenia zdjęć stereoskopowych. Jednak technologia okazała się nieodebrana i producenci zapomnieli o takich eksperymentach na kilka lat.

Wiosną 2014 roku na rynku pojawił się HTC One M8. Smartfon otrzymał dodatkowy moduł do pomiaru głębokości i oddzielenia obiektu od tła. W ten sposób firma wprowadziła tryb portretowy dwa lata wcześniej niż Apple.

Prawdziwy boom nastąpił w 2016 roku, kiedy to najwięksi producenci zaprezentowali swoje rozwiązania. Jednocześnie nie było jednego widoku tego, czego potrzebuje smartfon dwie kamery. Na przykład Huawei promował fotografię monochromatyczną za pomocą P9, który opracował we współpracy z Leicą. LG G5 polegał na shirik, podczas gdy Apple wprowadził teleobiektyw do fotografii portretowej i zoomu optycznego w iPhonie 7 Plus.

Jak się okazało, dwa aparaty to nie wszystko. Teraz prawie wszystkie smartfony na rynku są wyposażone w trzy obiektywy o różnych ogniskowych, a także aparaty do makrofotografii i pomiaru głębi.

Rosnące cechy

Jakość aparatów mobilnych zawsze była ograniczona fizycznymi ograniczeniami: niewielka grubość obudowy nie pozwalała na wyposażenie smartfonów w wysokiej jakości optykę i duże sensory. Jednak użytkownicy domagali się ulepszeń, firmy starały się zaspokoić ich potrzeby.

Skończyło się więc na aparatach wystających kilka milimetrów z ciała. Wzrosły również fizyczne wymiary czujników: jeśli pięć lat temu wahały się w granicach 1/3 ″, to teraz pojawiły się na rynku Samsung Galaxy S20 Ultra i Huawei P40 z czujnikami 1 / 1,3 ″. Czujniki obrazu wzrosły prawie dziewięciokrotnie, co znacznie poprawiło jakość zdjęć.

Duży obszar czujników pozwolił na zwiększenie rozdzielczości. Aparaty mobilne 48MP i 64MP stały się normą, a Samsung i Xiaomi mają już linię 108 megapikseli. Jednak zdjęcia o takiej rozdzielczości ważą za dużo, więc inżynierowie poszli na sztuczkę: łączone są informacje z sąsiednich pikseli. Zmniejsza to rozdzielczość, ale w zamian dostajemy mniej szumów i szerszy zakres dynamiki.

Co dalej

Wszystkie te innowacje sprawiły, że smartfony są idealnym zamiennikiem cyfrowych mydelniczek. Niemniej jednak nadal mają miejsce na rozwój. A nawet jeśli cechy fizyczne uderzą w sufit, oprogramowanie zawsze przyjdzie z pomocą.

Teraz fotografia obliczeniowa nabiera tempa: aparat robi serię zdjęć i sieci neuronowe na ich podstawie zbierają idealną ramkę, tłumiąc szumy, wyrównując jasność i korygując kolor. Metoda stosowana jest w Google Pixel 4, iPhone 11, Huawei P40 i wielu innych smartfonach. Przetwarzanie odbywa się automatycznie i niezauważalnie dla użytkownika - widzi on tylko wynik.

Wraz ze wzrostem produktywności możliwości aparatów stają się coraz szersze. Mogą już nagrywać wideo i przetwarzać je w czasie rzeczywistym: rozmazać tło lub uczynić je czarno-białym, pozostawiając obiekty w kolorze. Rozwija się też kierunek rzeczywistości rozszerzonej: Apple wyposażyło już iPada Pro w czujnik LiDAR do pracy z aplikacjami AR, a wkrótce technologia pojawi się także w iPhonie.

Kamery mobilne stają się kompleksem sprzętowo-programowym, którego możliwości nie do końca rozumiemy. Dlatego ciekawsze jest śledzenie najnowszych osiągnięć w tej dziedzinie i samodzielne ich testowanie.

Przeczytaj także📸

- Najlepsze aparaty do smartfonów 2019 roku od DxOMark

- Jak zrobić dobre zdjęcie: 6 podstawowych zasad

- 9 zalet smartfona z potrójnym aparatem